Red Pill Go Unreal Plugin

教學影片

通過Live Link即時接收來自Red Pill Go Hub之AI動補資料,於Unreal虛幻引擎中操作虛擬人(含臉部)。細部流程可參考以下教學影片

安裝方式

Red Pill Go Hub 以串流方式將人體骨架(Mannequin)動態傳輸至UE 版本 5.x,並以 ARKit 格式傳輸臉部動畫資料,無需特別安裝額外的第三方外掛。

INFO

此工作流程中我們假設Red Pill Go Hub和UE5都已正常安裝在同一本地網路中電腦上並能正常運行。

啟用LiveLink

- 創建新專案或打開現有專案

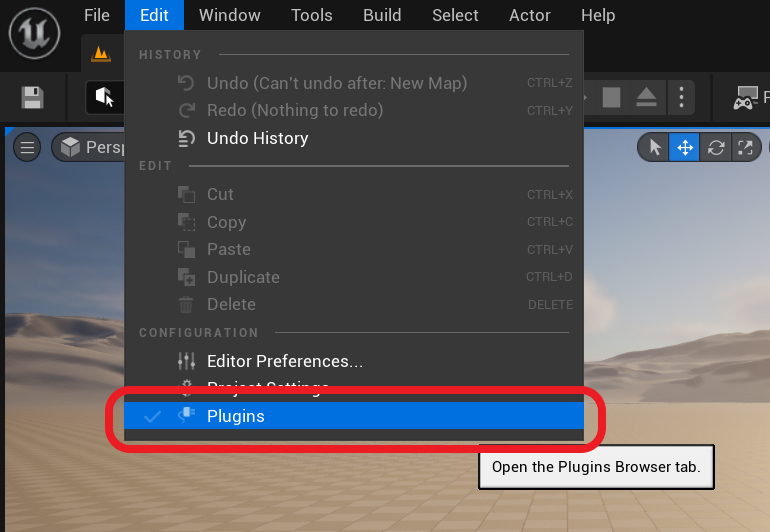

- 轉到Edit > Plugins

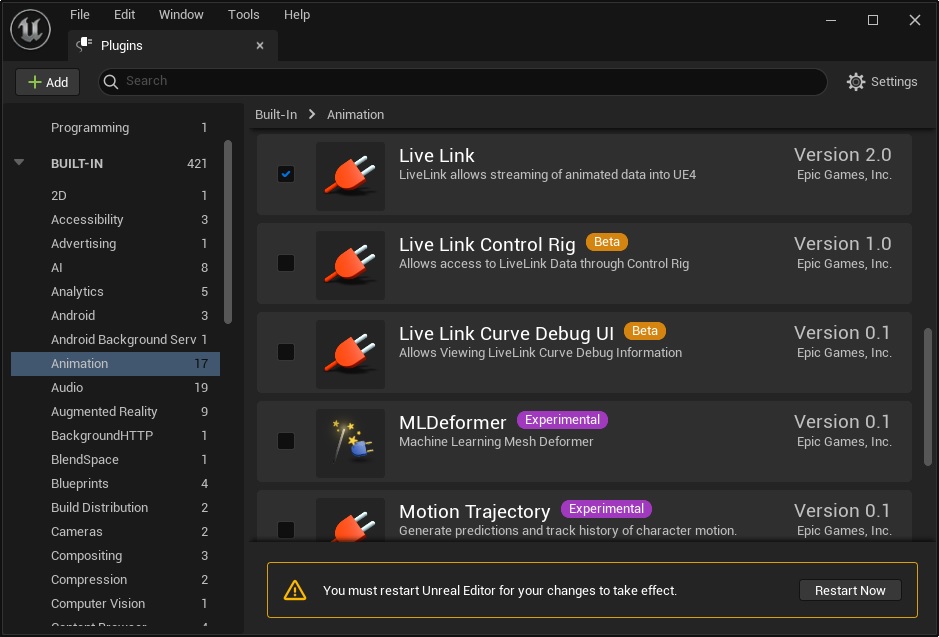

- 導航到BUILT-IN > Animation.。在這裡你應該看到LiveLink。確保啟用外掛程式。這裡會提示重新啟動。

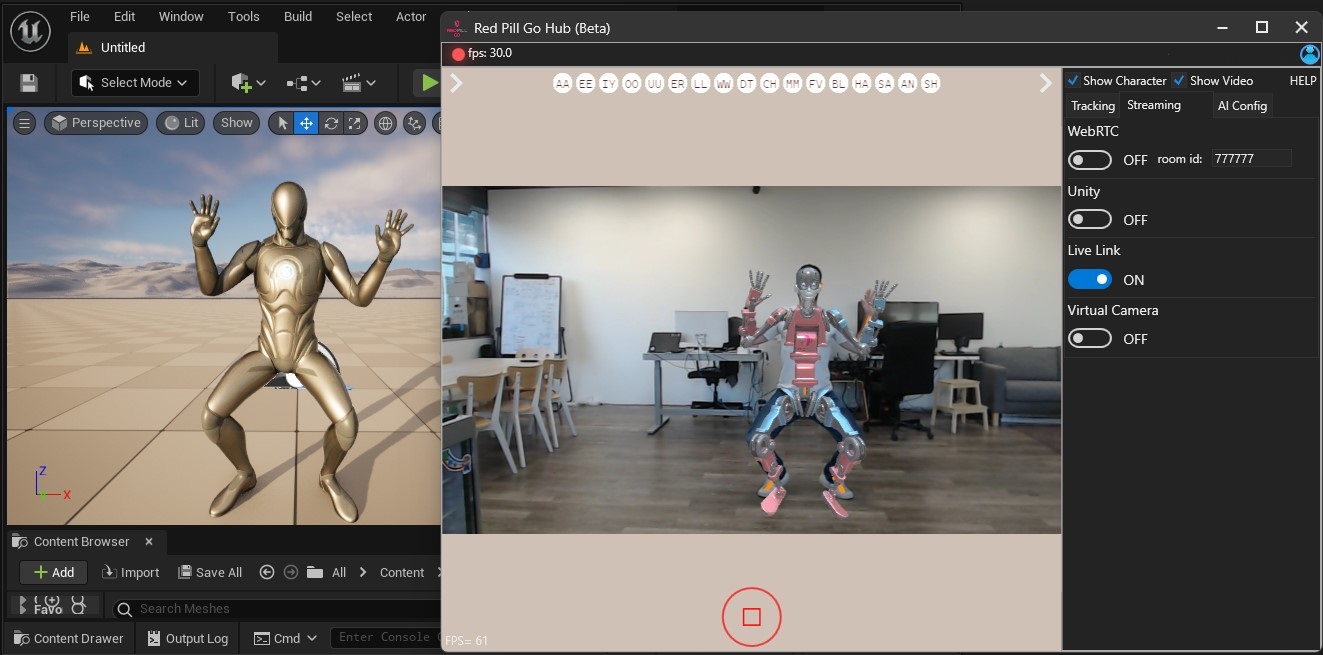

設置 UE5 從 Red Pill Go Hub 接收數據

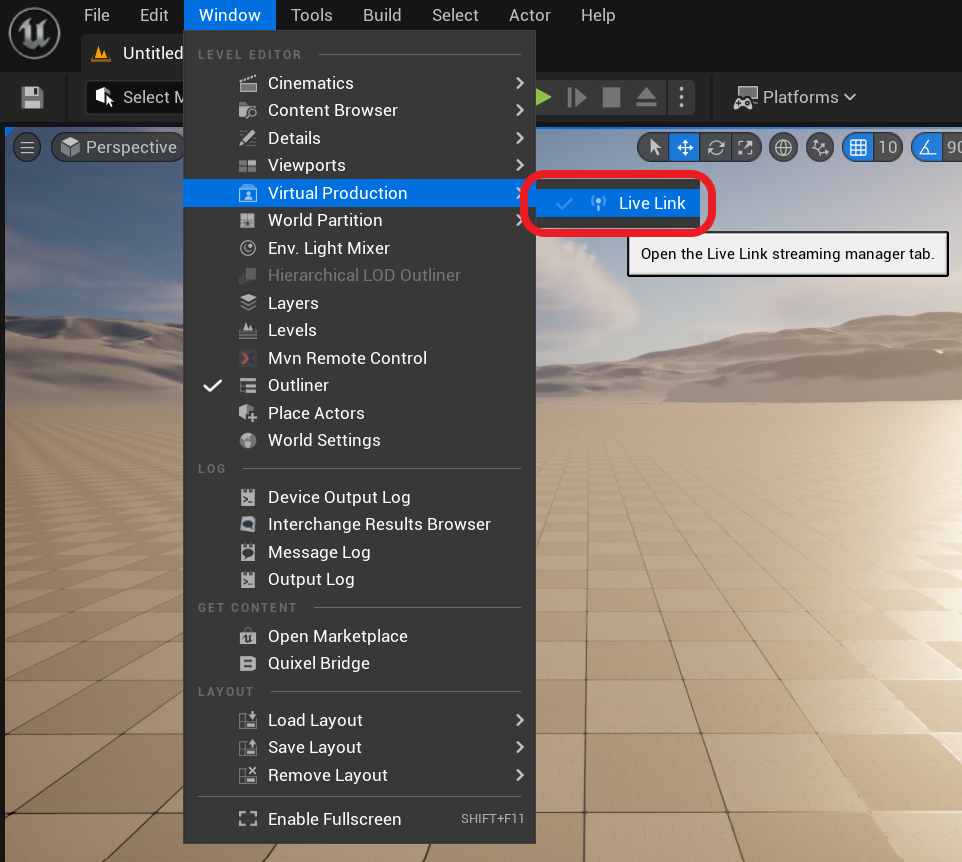

- 在專案中,轉到Window > Virtual Production > Live Link以啟用Live Link面板

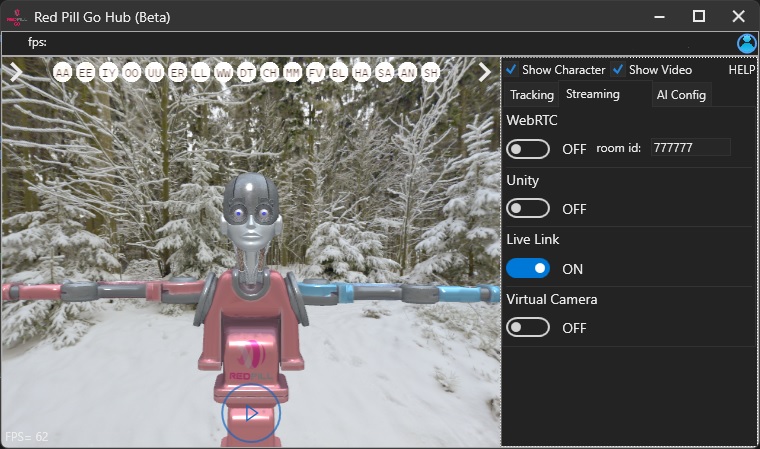

- 啟動Red Pill Go Hub並啟用Streaming > Live Link註冊一個Live Link來源

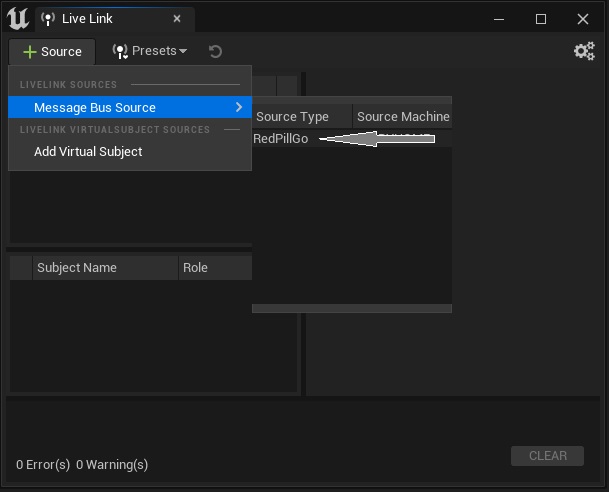

- 在「Live Link」面板中,按下 Source > Message Bus Source > RedPillGo

Details

如果您在不同台電腦上運行UE和Red Pill Go Hub而且未顯示RedPillGo於 Source,請確認兩台電腦位於同一本地網路中,並且沒有被Windows Defender擋住。

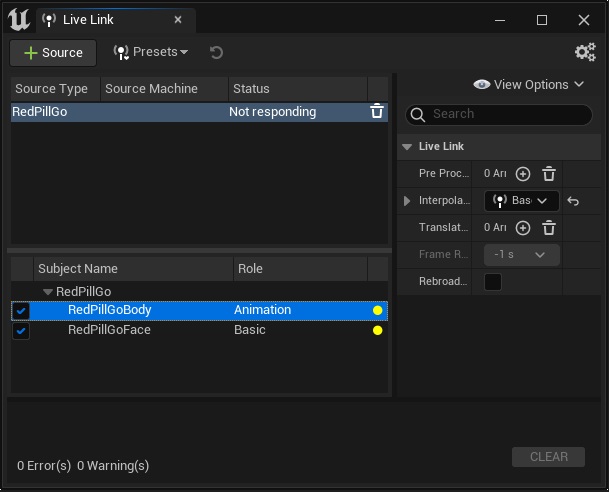

-確認RedPillGoBody和RedPillGoFace兩個主要物件存在

匯入UE Mannequin

有三種方法可以將Mannequin的骨架模型匯入專案:

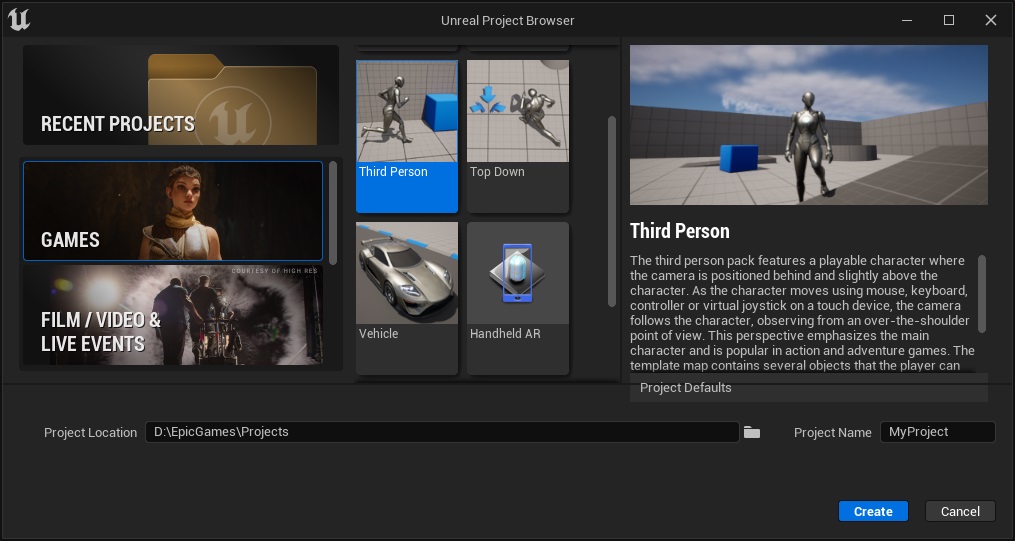

- 從第三人稱(Third Person)專案範本開始

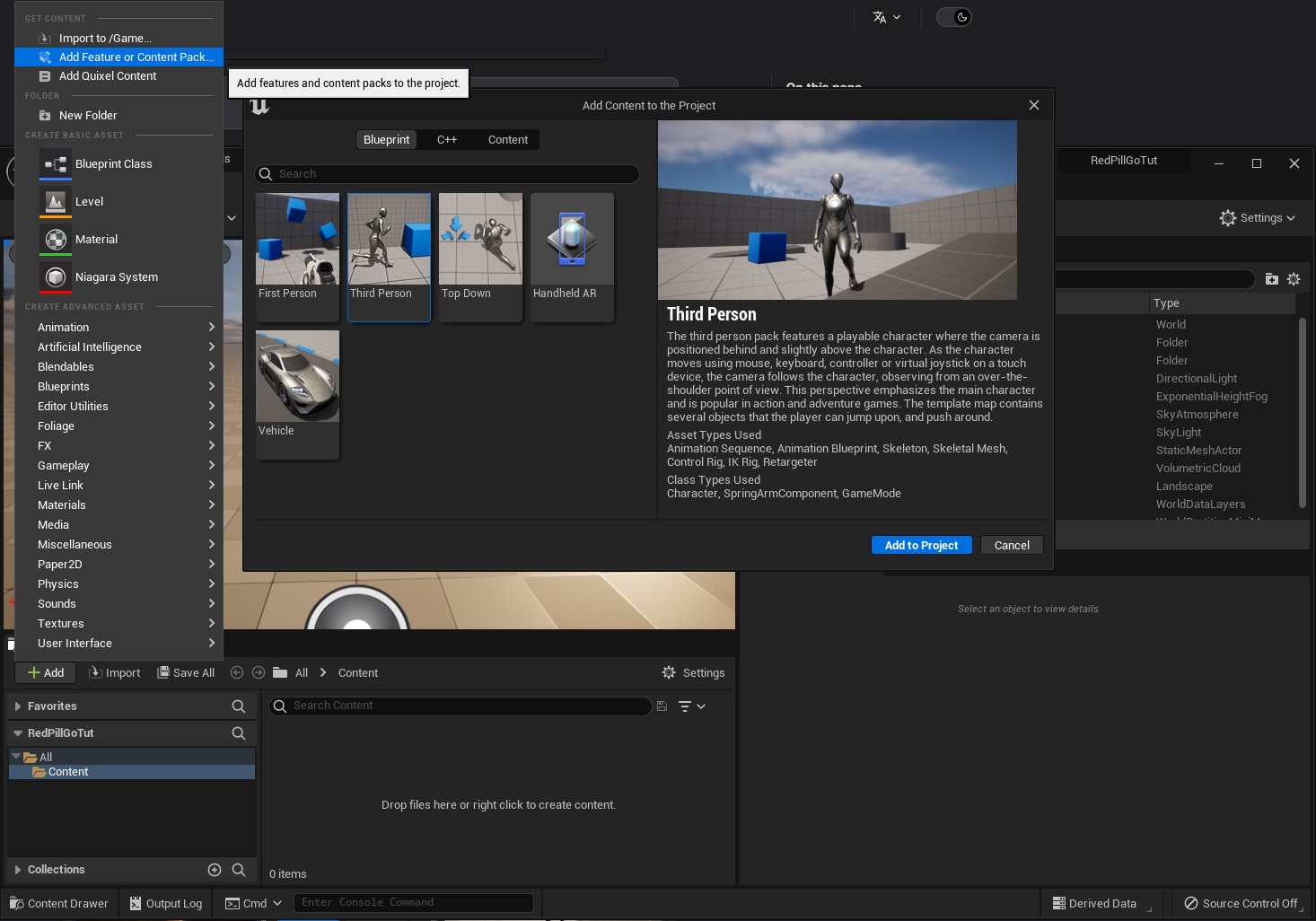

- 在Content Browser裡頭按Add > Add Feature or Content Pack > Third Person

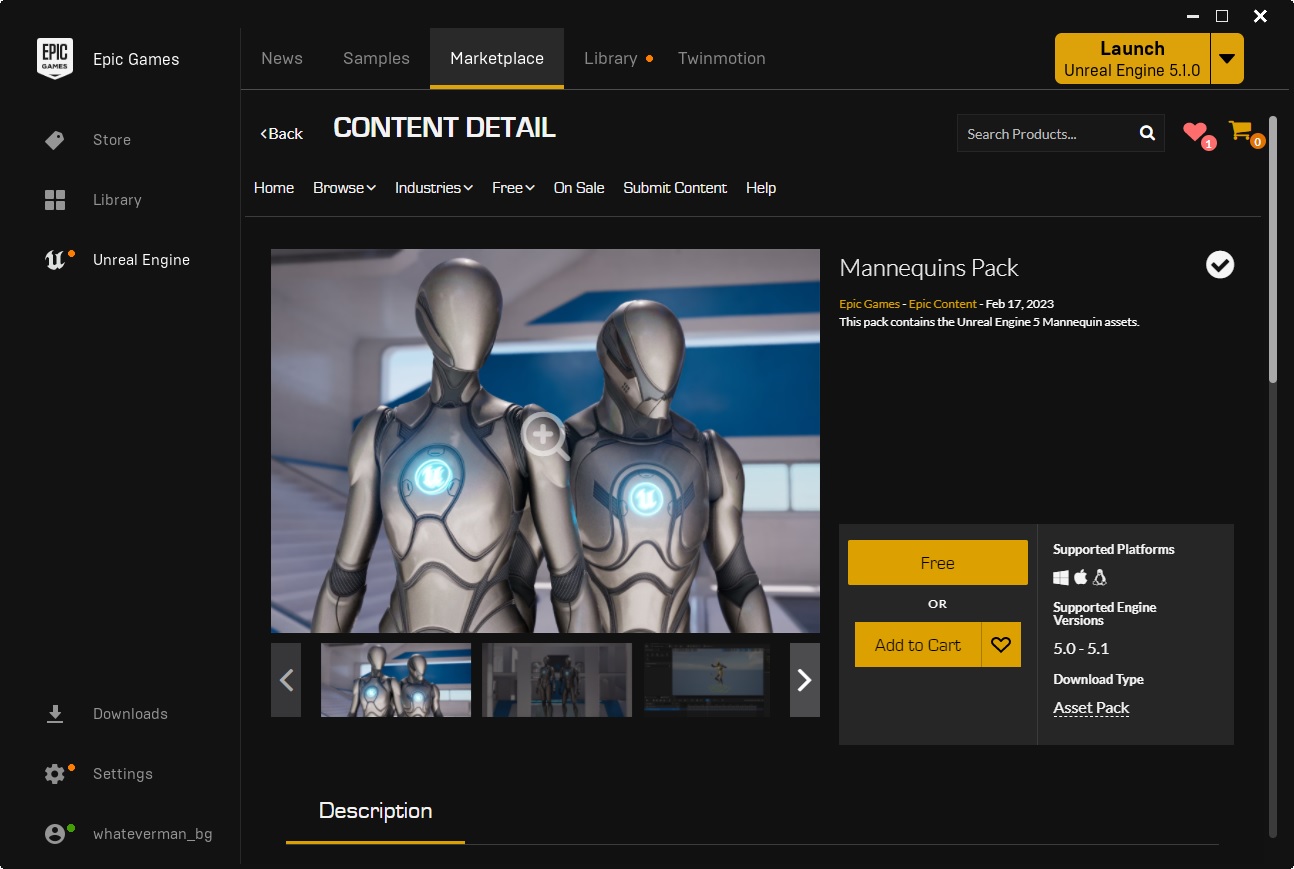

- 由UE Marketplace下載 [Mannequins Pack] 模特包(https://www.unrealengine.com/marketplace/en-US/product/mannequins-asset-pack)

- 由Vault保管庫中將下載好的資料包添加到專案中

建立動畫藍圖

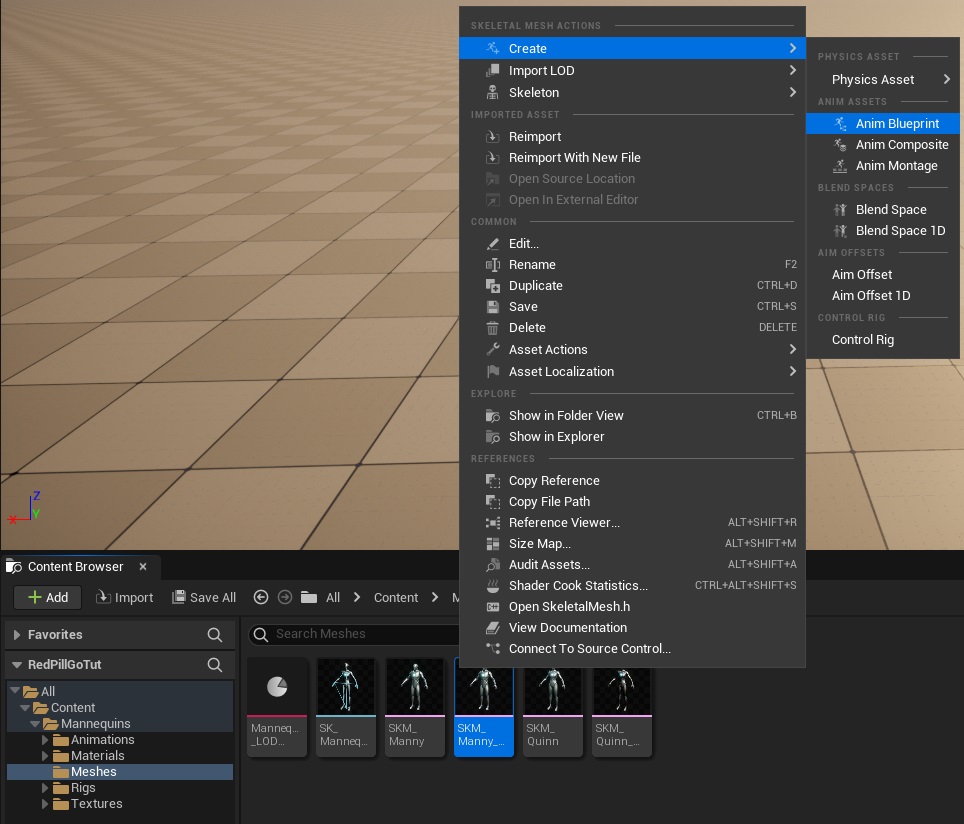

- 導航到內容瀏覽器 Content > Mannequins > Meshes > SKM_Manny_Simple or Content > Characters > Mannequins > Meshes > SKM_Manny_Simple具體決定在如何導入Mannequin模型的方式

- 右鍵按Create > Anim Blueprint

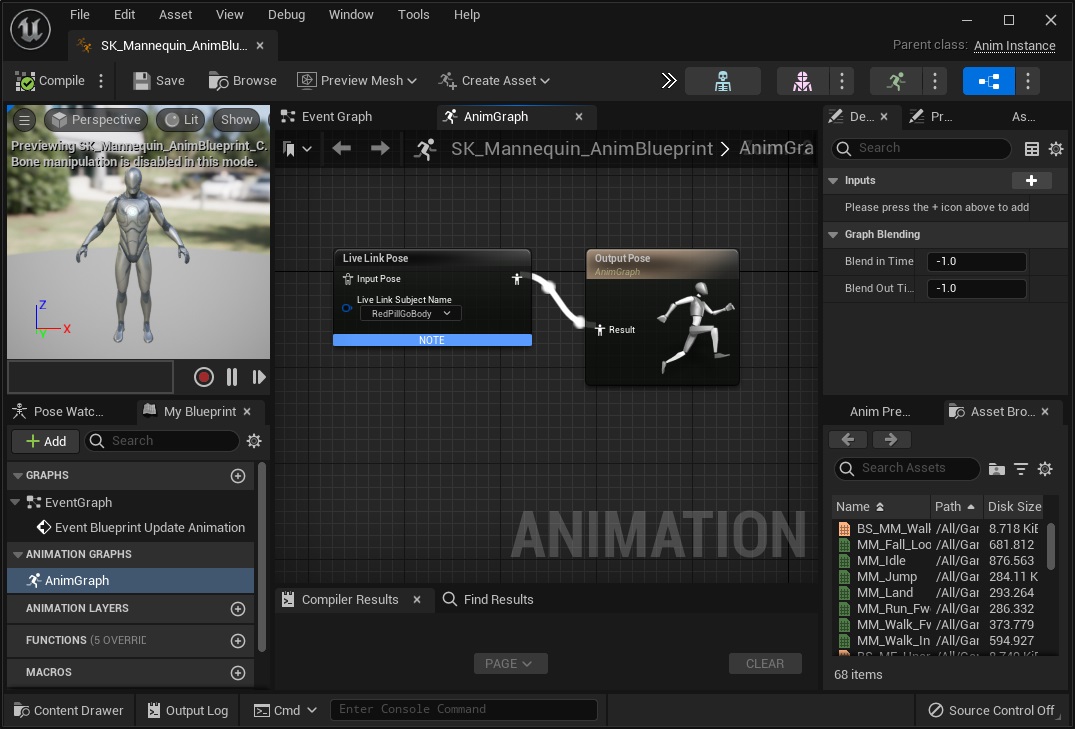

- 打開新的動畫藍圖,然後在「AnimGraph」面板中建立一個新的「LiveLinkPose」節點。選擇RedPillGoBody作為LiveLink主題名稱,並將輸出端連接到”Output Pose”的”Result pin”

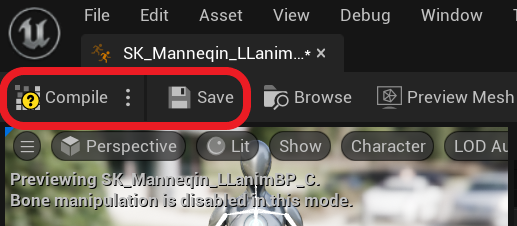

- 現在可以編譯然後保存動畫藍圖

- 將動畫藍圖從Content Browser拖曳到場景內

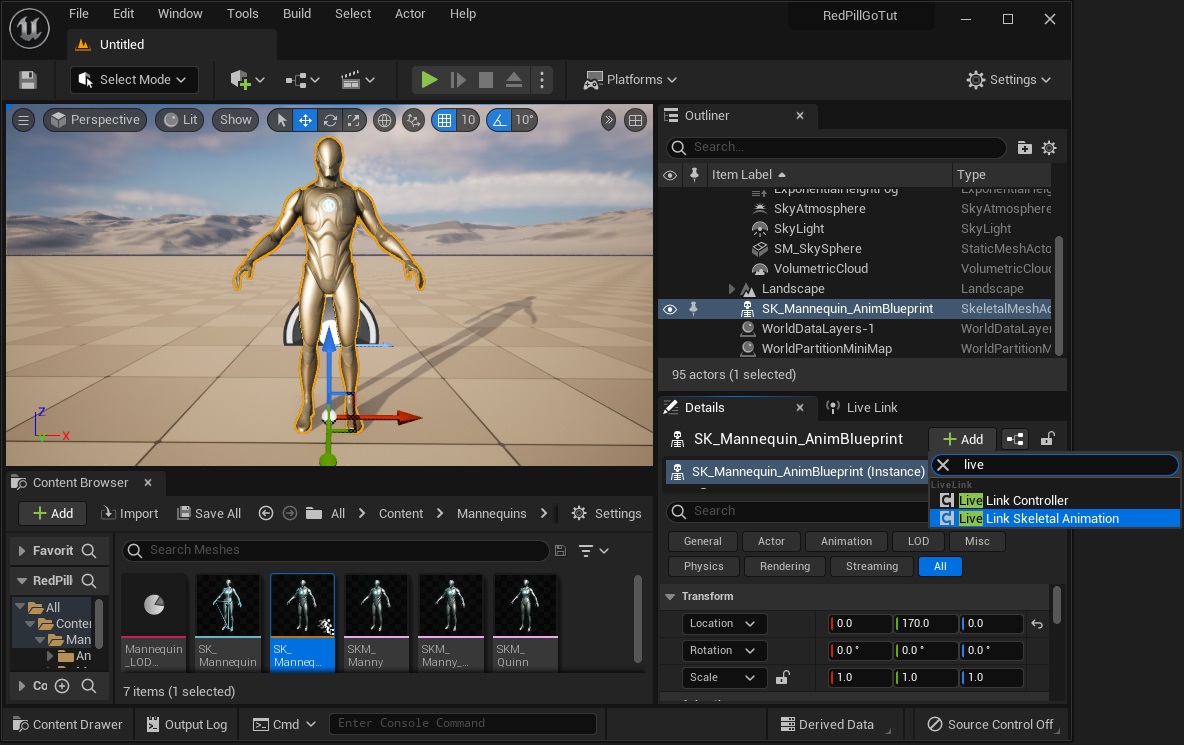

添加「Live Link Skeletal Animation」元件

此方法將允許Mannequin在UE編輯器中自動接收即時串流數據,而不需按下Play播放

- 在Outliner中選擇Mannequin,然後在詳細資訊Details tab中按下 +Add Live Link Skeletal Animation

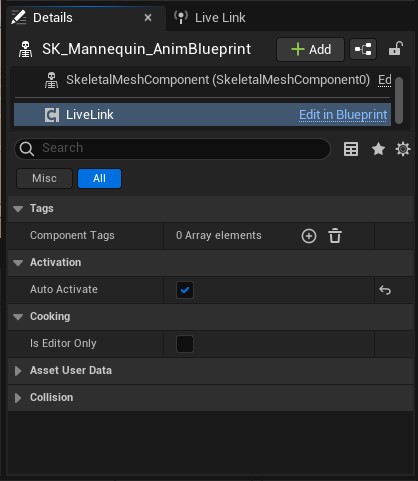

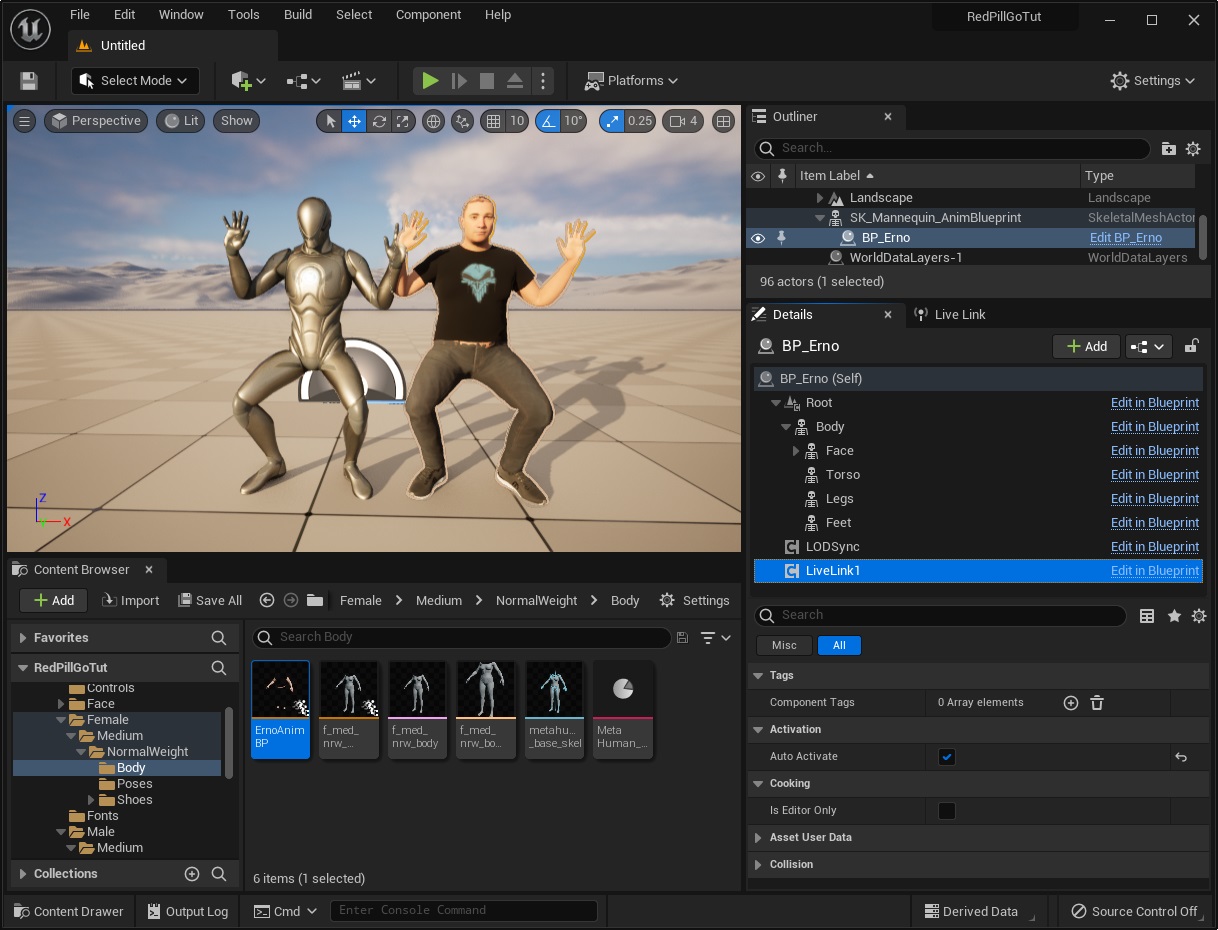

- 在層次結構中選擇新元件,這時候他將被命名為“LiveLink”

- 然後在“Activation”部分,開啟“自動啟動Auto Activate”

- 這時候就會看到您的角色已接收RedPillGoBody的串流數據進行即時動畫

使用Metahuman

匯入Metahuman

- 在內容瀏覽器中,按下 +Add > Add Quixel Content

- 使用您的帳戶登錄,先下載後添加Metahuman到您的專案中

- 在內容瀏覽器下的Content > MetaHumans > 「Character Name」> BP_「Character Name」找到你的Metahuman並將其添加到場景中

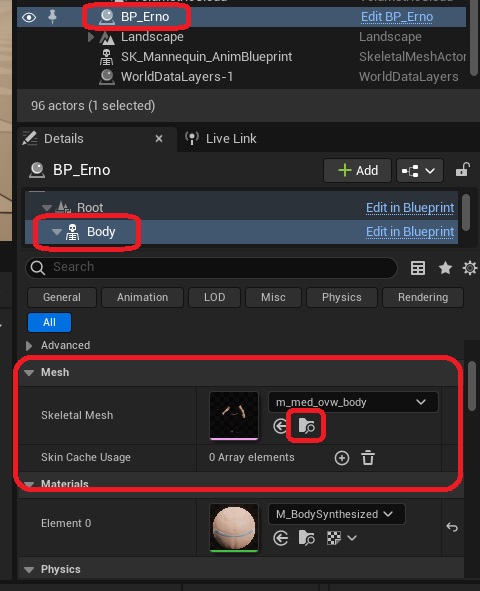

重定位身體動畫

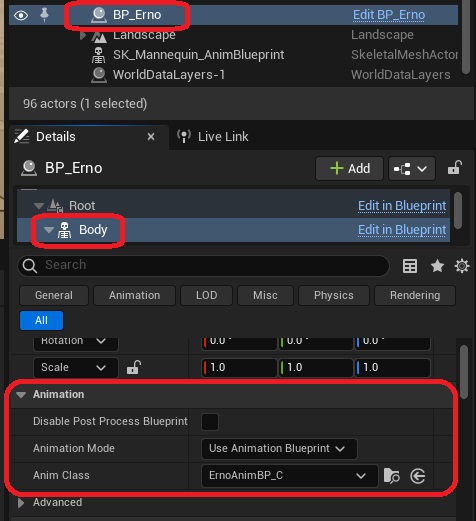

- 選擇該Metahuman,然後在” details tab”選項中選擇「Body」

- 導航到Mesh部分,然後按下"Browse to"按鈕查看骨架Mesh

- 右鍵按下骨架Mesh然後建立新的動畫藍圖並將其打開

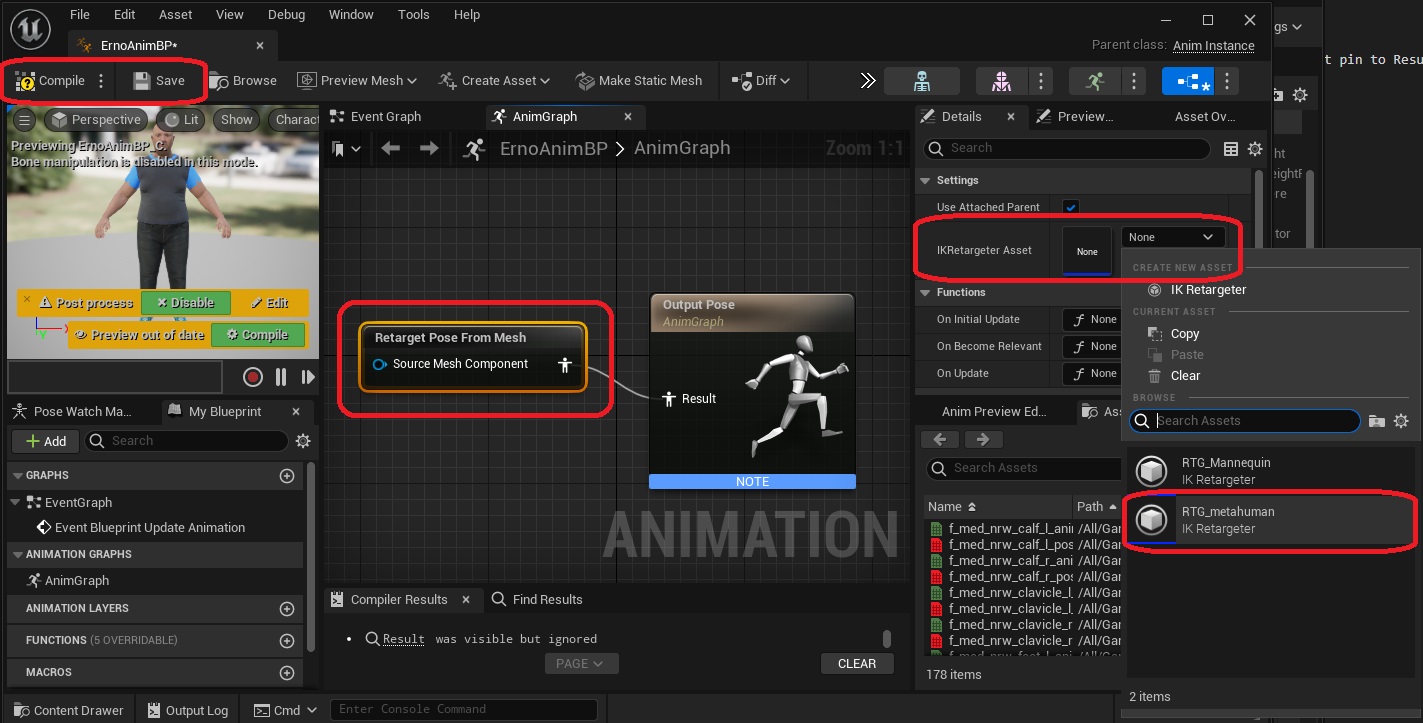

- 在“AnimGraph”面板中,創建“Retarget Pose From Mesh”節點並將其連接到“Output Pose”

- 選擇“Retarget Pose From Mesh”節點,然後在“Settings”下的“Details”面板中將RTG_metahuman指定給 IKRetargeter 資產(Asset)

- 編譯並保存藍圖

- 返回Outliner選擇Metahuman,然後在” details tab”中選擇“Body”

- 導航到Animation section,然後將動畫模式改為” Use Animation Blueprint”

- 由Anim Class選擇在上一步驟中建立的動畫藍圖

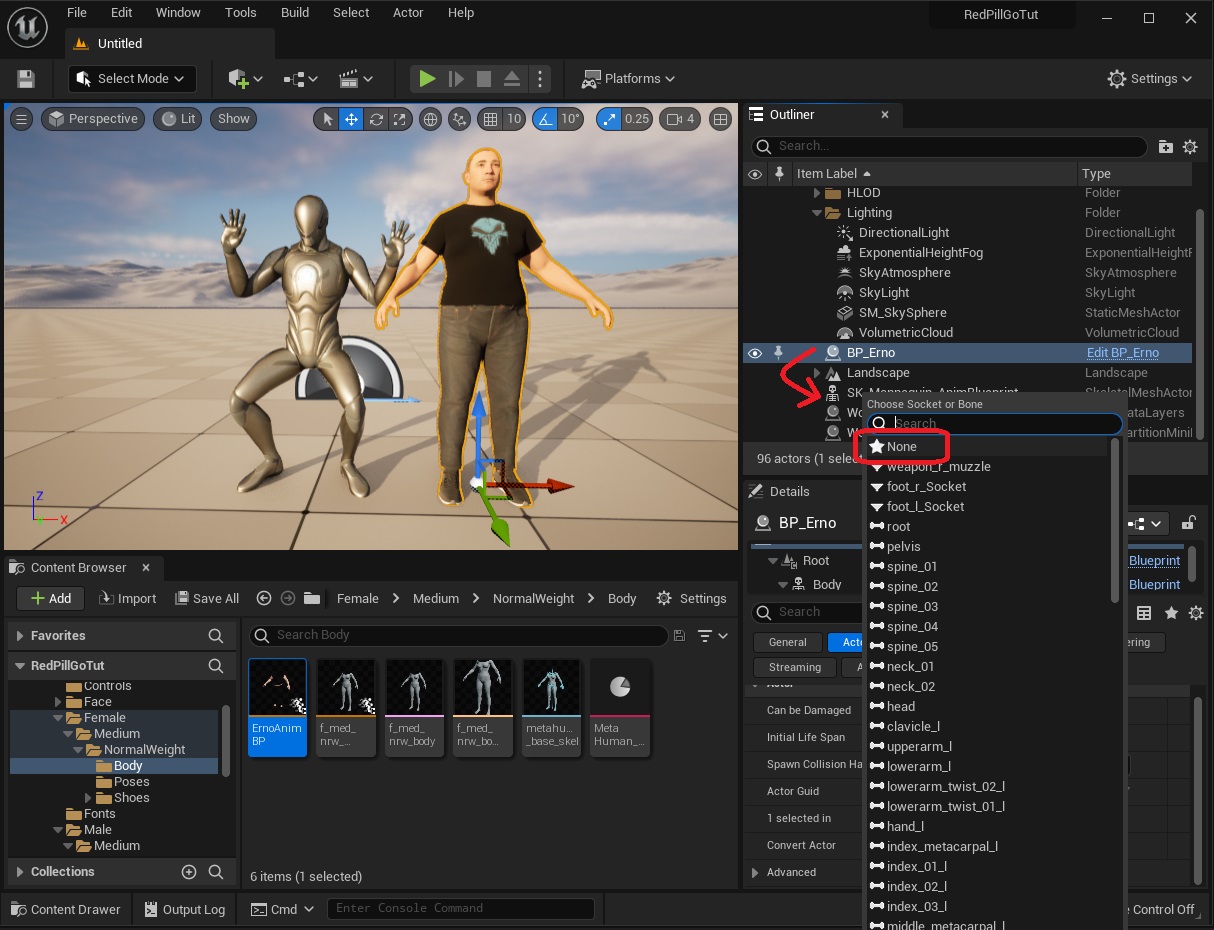

- 利用從Outliner中的拖曳方式把Metahuman附加到Mannequin上頭

- 將「Socket」或「Bone」選擇為“None”

添加「Live Link Skeletal Animation」元件

我們也需要對 Metahuman 重複此步驟,以利在UE編輯器中能自動接收即時串流數據,而不需按下播放鍵(Play)

- 在Outliner中選擇Metahuman,然後在Details tab按下 +Add Live Link Skeletal Animation

- 來自Mannequin的即時骨架動態資料現在已完成重定位至Metahuman。

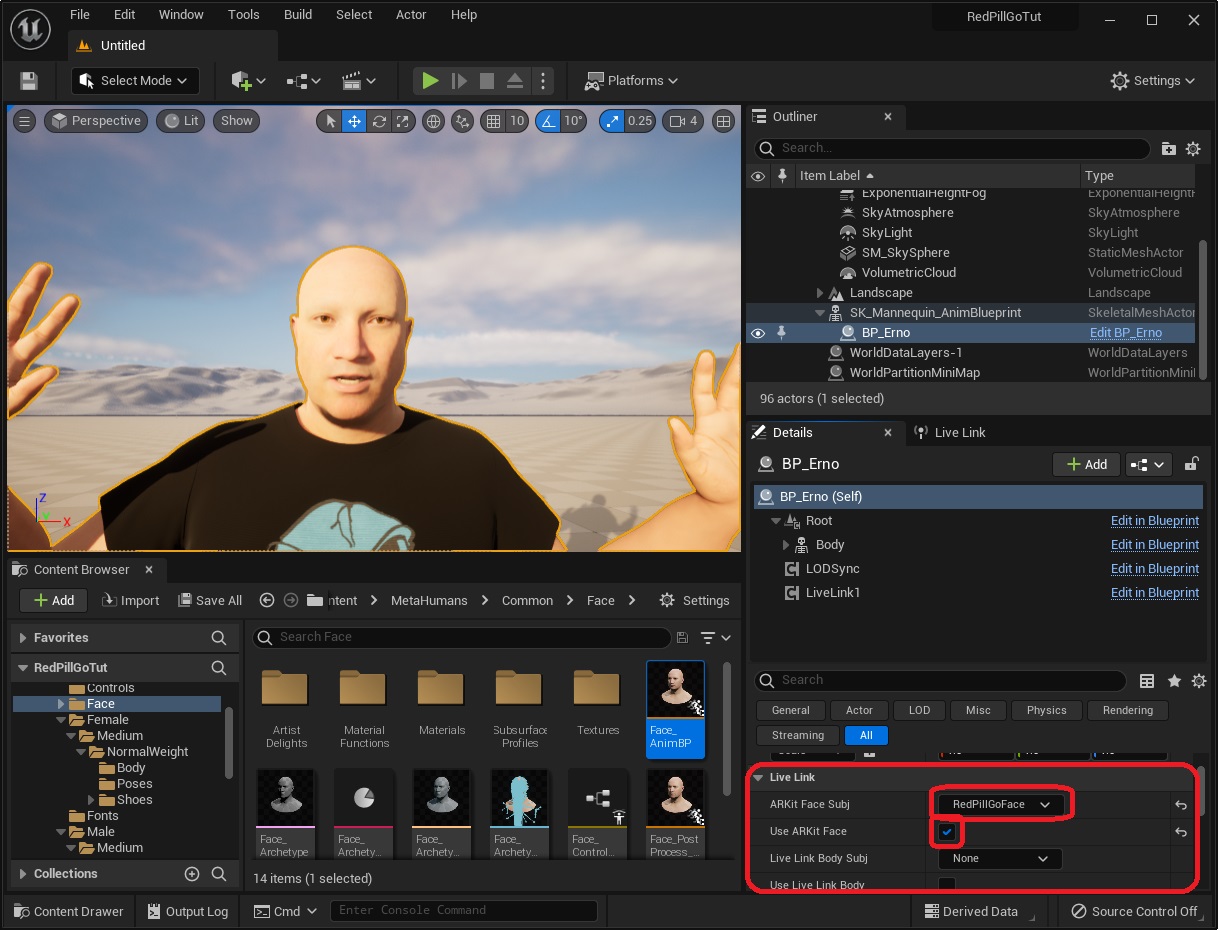

設置臉部動態

- 選擇Metahuman,然後在Details tab中進入最上層元件

- 導航到Live Link部分

- 在ARKit Face Subj裡選擇RedPillFace

- 勾選使用ArKit Face

TIP

如果您只想看到場景中的Metahuman而不想看到Mannequin,可以很簡單的建立一個透明材質然後指定給Metahuman的Mesh即可